本文最后更新于:2022年7月3日 下午

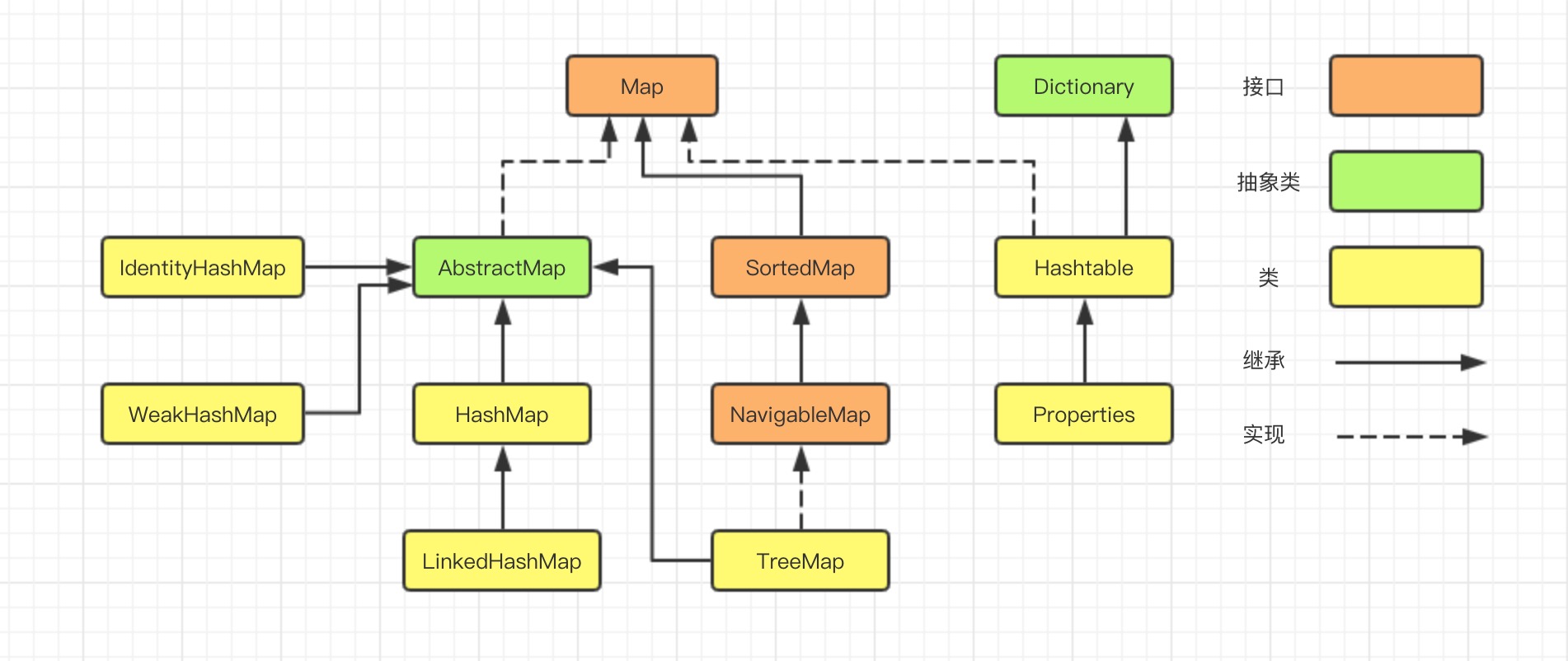

JAVA集合框架结构 首先我们知道JAVA的集合框架中有两大体系,一类是Collection,另一类是Map。其中Collection中包含List(ArrayList、LinkedList、Vector、还有继承自Vector的Stack)、Set(HashSet、LinkedHashSet、继承自Set的SortedSet接口下的TreeSet)、Queue(继承自Queue的Deque双向队列)。

Map下包括HashMap、LinkedHashMap、(继承自Map的SortedMap接口,以及其实现类TreeMap)、Hashtable等实现类。下面就一个一个来进行解析。

Collection List(列表) List接口下有ArrayList、LinkedList(LinkedList是实现了List接口和Deque接口的类)、Vector、Stack

ArrayList ArrayList 是一个动态数组结构,支持随机存取,尾部插入删除方便,内部插入删除效率低(因为要移动数组元素);如果内部数组容量不足则自动扩容,因此当数组很大时,效率较低。

ArrayList是我们平时使用的比较多的一个数据结构了,其底层实现为Array数组,我们看看他的代码。

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 transient Object[] elementData; private int size;private static final int DEFAULT_CAPACITY = 10 ;public ArrayList (int initialCapacity) {if (initialCapacity > 0 ) {this .elementData = new Object [initialCapacity];else if (initialCapacity == 0 ) {this .elementData = EMPTY_ELEMENTDATA;else {throw new IllegalArgumentException ("Illegal Capacity: " +public ArrayList () {this .elementData = DEFAULTCAPACITY_EMPTY_ELEMENTDATA;public ArrayList (Collection<? extends E> c) {if ((size = elementData.length) != 0 ) {if (elementData.getClass() != Object[].class)else {this .elementData = EMPTY_ELEMENTDATA;

我们看到其如果进行无参构造的话,那么会得到一个DEFAULT_CAPACITY=10的ArrayList,如果有指定初始容量,且大小合规的话,那么就创建初始化大小的ArrayList,如果参数是实现了Collection接口的,那么就调用Collection接口下的toArray()方法,将其变成数组,然使用Arrays.copyof()方法将原来容器内的元素拷贝到当前ArrayList下。

需要注意的是其大小达到其容量的时候会触发grow()方法。

1 2 3 4 5 6 7 8 9 10 11 private void grow (int minCapacity) {int oldCapacity = elementData.length;int newCapacity = oldCapacity + (oldCapacity >> 1 );if (newCapacity - minCapacity < 0 )if (newCapacity - MAX_ARRAY_SIZE > 0 )

可以看到其扩容后的容量为int newCapacity = oldCapacity + (oldCapacity >> 1);即新容量=旧容量*1.5;

LinkedList LinkedList 是一个双向链表结构,在任意位置插入删除都很方便,但是不支持随机取值,每次都只能从一端开始遍历,直到找到查询的对象,然后返回;不过,它不像 ArrayList 那样需要进行内存拷贝,因此相对来说效率较高,但是因为存在额外的前驱和后继节点指针,因此占用的内存比 ArrayList 多一些。

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 transient Node<E> first;transient Node<E> last;transient int size = 0 ;private static class Node <E> {this .item = element;this .next = next;this .prev = prev;public LinkedList () {public LinkedList (Collection<? extends E> c) {this ();

下面看一下其add方法。

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 public boolean add (E e) {return true ;void linkLast (E e) {final Node<E> l = last;final Node<E> newNode = new Node <>(l, e, null );if (l == null )else

Vector Vector 也是一个动态数组结构,一个元老级别的类,早在 jdk1.1 就引入进来类,之后在 jdk1.2 里引进 ArrayList,ArrayList 大部分的方法和 Vector 比较相似,两者是不同的,Vector 是允许同步访问的,Vector 中的操作是线程安全的,但是效率低,而 ArrayList 所有的操作都是异步的,执行效率高,但不安全!需要注意的是Vector和ArrayList的扩容方式有所区别,Vector的扩容是新容量=旧容量*2

1 2 3 4 5 6 7 8 9 10 11 private void grow (int minCapacity) {int oldCapacity = elementData.length;int newCapacity = oldCapacity + ((capacityIncrement > 0 ) ?if (newCapacity - minCapacity < 0 )if (newCapacity - MAX_ARRAY_SIZE > 0 )

关于Vector,现在用的很少了,因为里面的get、set、add等方法都加了synchronized,所以,执行效率会比较低,如果需要在多线程中使用,可以采用下面语句创建 ArrayList 对象

1 List<Object > list =Collections.synchronizedList(new ArrayList<Object >());

也可以考虑使用复制容器 java.util.concurrent.CopyOnWriteArrayList进行操作,例如:

1 final CopyOnWriteArrayList<Object > cowList = new CopyOnWriteArrayList<String >(Object );

其底层代码和ArrayList基本相同,不同点在于其对数组的操作都加入了synchronized关键词,所以保证了其再多线程条件下也是可以保证其线程的安全性的,但是由于使用了sychronized关键词,所以导致其效率不太行。所以一般推荐使用Collections.synchronizedList进行操作,是因为Vector读写性能可以和Collections.synchronizedList比肩(因为虽然一个是是在方法上进行加锁,另一个是在同步代码块内加锁,但是其锁住的范围几乎相同),但Collections.synchronizedList不仅可以包装ArrayList,也可以包装其他List,扩展性和兼容性更好。

Stack Stack 是 Vector 的一个子类,本质也是一个动态数组结构,不同的是,它的数据结构是先进后出,取名叫栈!

关于Stack,现在用的也很少,因为有个ArrayDeque双端队列,可以替代Stack所有的功能,并且执行效率比它高!

Set(集合) HashSet 说到HashSet,那就不得不说HashMap,HashSet底层是基于 HashMap 的k实现的,元素不可重复,特性同 HashMap。

具体的实现与HashMap不同的是,其value是固定的一个Object对象。

我们可以查看源码

1 2 3 4 private static final Object PRESENT = new Object ();private transient HashMap<E,Object> map;

每次进行add操作的时候都是执行了

1 2 3 4 5 public boolean add (E e) {return map.put(e, PRESENT)==null ;

其他的部分和HashMap基本相同,如果对HashMap不熟悉的话可以看后面关于HashMap的详细解析。

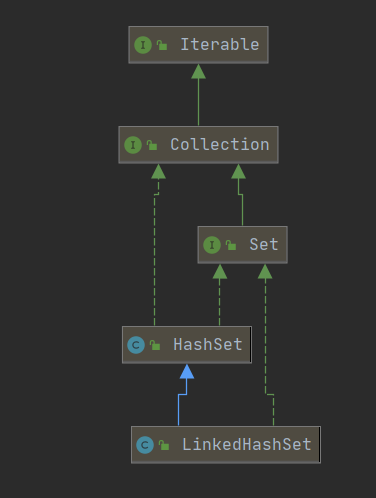

LinkedHashSet LinkedHashSet底层也是基于 LinkedHashMap 的k实现的,一样元素不可重复,特性同 LinkedHashMap。LinkedHashSet集合同样是根据元素的hashCode值来决定元素的存储位置,但是它同时使用链表维护元素的次序。这样使得元素看起 来像是以插入顺序保存的,也就是说,当遍历该集合时候,LinkedHashSet将会以元素的添加顺序访问集合的元素。

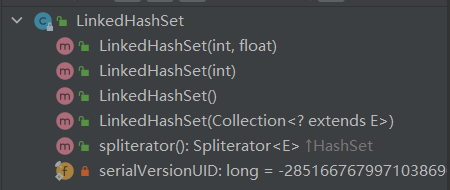

我们看一下他的源码,发现其方法都是用了父类HashSet的方法,然后其父类也是基本使用HashMap实现的,所以LinkedHashMap还是和HashMap有着千丝万缕的关系,当然和LinkedHashMap有着更近的关系,我们看他的构造函数,发现其使用的构造函数还是LinkedHashMap。

1 2 3 HashSet(int initialCapacity, float loadFactor, boolean dummy) {new LinkedHashMap <>(initialCapacity, loadFactor);

再看看他的类图是不是和HashMap很像呢?

类的方法也基本上只有构造函数,连重写都没有,真的美滋滋。

TreeSet TreeSet是SortedSet接口的唯一实现类,TreeSet可以确保集合元素处于排序状态。TreeSet支持两种排序方式,自然排序 和定制排序,其中自然排序为默认的排序方式。向TreeSet中加入的应该是同一个类的对象。

TreeSet也是对NavigableSet的继承,在NavigableSet顾名思义是一导航的接口,它定义了方法 lower、floor、ceiling 和 higher 分别返回小于、小于等于、大于等于、大于给定元素的元素,如果不存在这样的元素,则返回 null,通过这个导航类来实现排序的功能。

其底层是根据红黑树来进行实现的,具体关于红黑树的讲解参考:**https://zhuanlan.zhihu.com/p/79980618 **

Queue(队列) Queue是一个队列集合,队列通常是指“先进先出”(FIFO)的容器。新元素插入(offer)到队列的尾部,访问元素(poll)操作会返回队列头部的元素。通常,队列不允许随机访问队列中的元素。

ArrayDeque ArrayQueue是一个基于数组实现的双端队列,可以想象,在队列中存在两个指针,一个指向头部,一个指向尾部,因此它具有“FIFO队列”及“栈”的方法特性。

其具体的实现是一个数组,其扩容方法是将容量扩大为原来的两倍,即新容量=旧容量<<1;

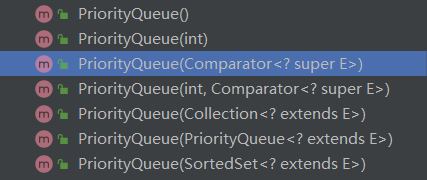

PriorityQueue PriorityQueue也是一个队列的实现类,此实现类中存储的元素排列并不是按照元素添加的顺序进行排列,而是内部会按元素的大小顺序进行排列,是一种能够自动排序的队列。

LinkedList LinkedList是List接口的实现类,也是Deque的实现类,底层是一种双向链表的数据结构,LinkedList可以根据索引来获取元素,增加或删除元素的效率较高,如果查找的话需要遍历整合集合,效率较低,LinkedList同时实现了stack、Queue、PriorityQueue的所有功能。

我们看看他的构造函数:

内部实现是使用数组,构造函数将上面集中接口初始化的方式都涵盖了。

重要的几个方法 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 48 49 50 51 52 public boolean offer (E e) {if (e == null )throw new NullPointerException ();int i = size;if (i >= queue.length)1 );1 ;if (i == 0 )0 ] = e;else return true ;private void grow (int minCapacity) {int oldCapacity = queue.length;int newCapacity = oldCapacity + ((oldCapacity < 64 ) ?2 ) :1 ));if (newCapacity - MAX_ARRAY_SIZE > 0 )private void siftUp (int k, E x) {if (comparator != null )else private void siftUpComparable (int k, E x) {super E> key = (Comparable<? super E>) x;while (k > 0 ) {int parent = (k - 1 ) >>> 1 ;Object e = queue[parent];if (key.compareTo((E) e) >= 0 )break ;

Map(映射) Map(映射) Map是一个双列集合,其中保存的是键值对,键要求保持唯一性,值可以重复。

HashMap HashMap是使用数组和单链表(在JDK1.8红黑树)组成的数据结构,因为使用的是哈希表存储元素,所以输入的数据与输出的数据,顺序基本不一致,另外,HashMap最多只允许一条记录的 key 为 null。

HashMap应该是我们日常开发中使用的最多的一个工具类,本人的话就经常用它来传递JSON数据给前端。

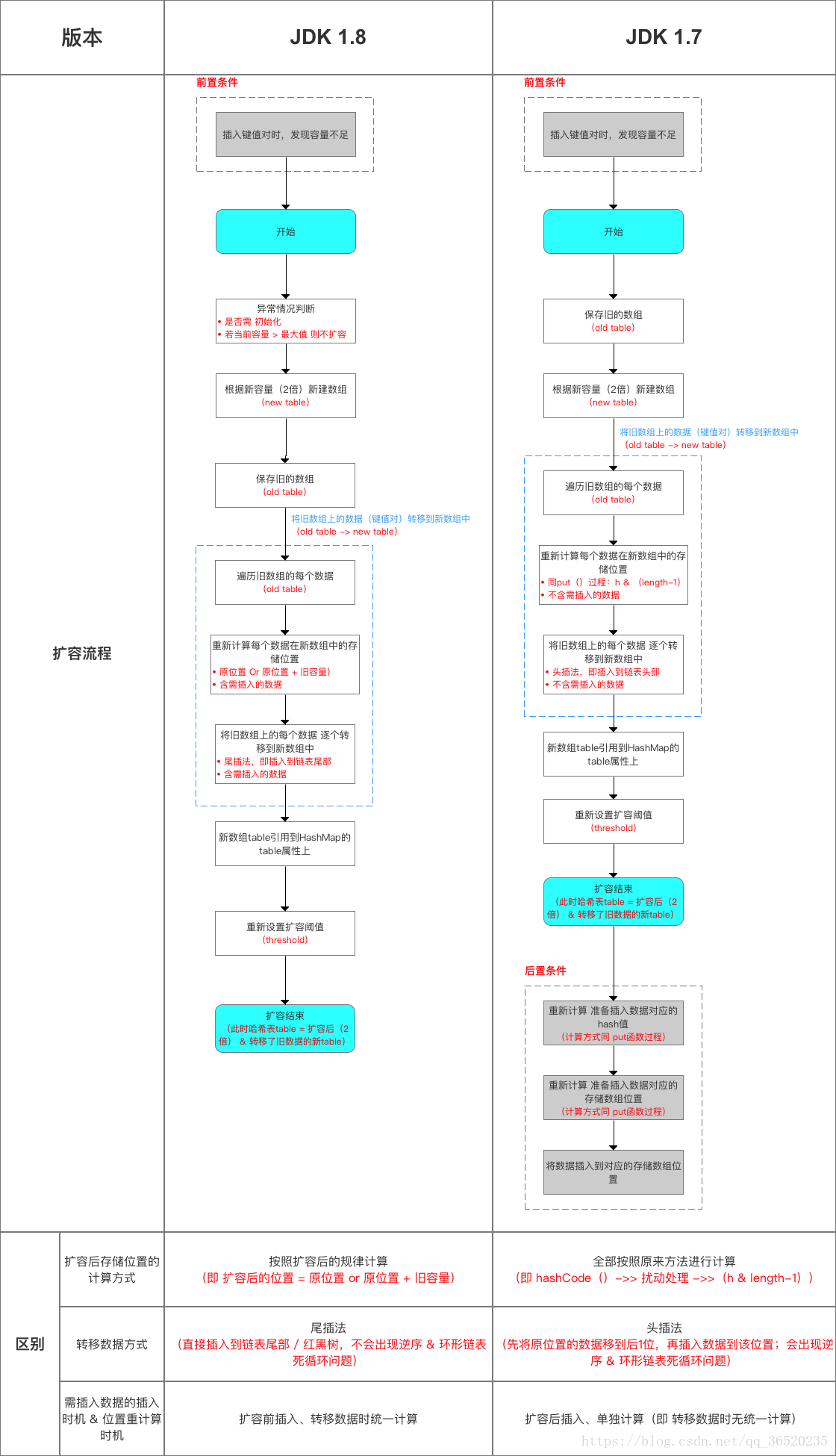

说到HashMap的历史,在JDK1.7中,HashMap是使用Entry进行对节点的存储,而JDK1.8,中使用Node和TreeNode静态内部类进行数据的存储。JDK1.7是用单链表进行的纵向延伸,当采用头插法时会容易出现逆序且环形链表死循环问题。但是在JDK1.8之后是因为加入了红黑树使用尾插法,能够避免出现逆序且链表死循环的问题。

初始化方法:

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 static final float DEFAULT_LOAD_FACTOR = 0.75f ;static final int DEFAULT_INITIAL_CAPACITY = 1 << 4 ; public HashMap () {this .loadFactor = DEFAULT_LOAD_FACTOR; public HashMap (Map<? extends K, ? extends V> m) {this .loadFactor = DEFAULT_LOAD_FACTOR;false );public HashMap (int initialCapacity, float loadFactor) {if (initialCapacity < 0 )throw new IllegalArgumentException ("Illegal initial capacity: " +if (initialCapacity > MAXIMUM_CAPACITY)if (loadFactor <= 0 || Float.isNaN(loadFactor))throw new IllegalArgumentException ("Illegal load factor: " +this .loadFactor = loadFactor;this .threshold = tableSizeFor(initialCapacity);

重要的方法 Hash算法 1 2 3 4 static final int hash (Object key) {int h;return (key == null ) ? 0 : (h = key.hashCode()) ^ (h >>> 16 );

Put方法 1 2 3 public V put (K key, V value) {return putVal(hash(key), key, value, false , true );

看到put方法调用了putval方法,去看看

Putval 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 48 49 50 51 52 53 54 55 56 57 58 59 60 61 62 63 64 65 66 final V putVal (int hash, K key, V value, boolean onlyIfAbsent, boolean evict) {int n, i;if ((tab = table) == null || (n = tab.length) == 0 )if ((p = tab[i = (n - 1 ) & hash]) == null )null );else {if (p.hash == hash &&null && key.equals(k))))else if (p instanceof TreeNode)this , tab, hash, key, value);else {for (int binCount = 0 ; ; ++binCount) {if ((e = p.next) == null ) {null );if (binCount >= TREEIFY_THRESHOLD - 1 ) break ;if (e.hash == hash &&null && key.equals(k))))break ;if (e != null ) { V oldValue = e.value;if (!onlyIfAbsent || oldValue == null )return oldValue;if (++size > threshold)return null ;

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 48 49 50 51 52 53 54 55 56 57 58 59 60 61 62 63 64 65 66 67 68 69 70 71 72 73 74 75 76 77 78 79 80 final Node<K,V>[] resize() {int oldCap = (oldTab == null ) ? 0 : oldTab.length;int oldThr = threshold;int newCap, newThr = 0 ;if (oldCap > 0 ) {if (oldCap >= MAXIMUM_CAPACITY) {return oldTab;else if ((newCap = oldCap << 1 ) < MAXIMUM_CAPACITY &&1 ; else if (oldThr > 0 ) else {int )(DEFAULT_LOAD_FACTOR * DEFAULT_INITIAL_CAPACITY);if (newThr == 0 ) {float ft = (float )newCap * loadFactor;float )MAXIMUM_CAPACITY ?int )ft : Integer.MAX_VALUE);@SuppressWarnings({"rawtypes","unchecked"}) new Node [newCap];if (oldTab != null ) {for (int j = 0 ; j < oldCap; ++j) {if ((e = oldTab[j]) != null ) {null ;if (e.next == null )1 )] = e;else if (e instanceof TreeNode)this , newTab, j, oldCap);else { null , loTail = null ;null , hiTail = null ;do {if ((e.hash & oldCap) == 0 ) {if (loTail == null )else else {if (hiTail == null )else while ((e = next) != null );if (loTail != null ) {null ;if (hiTail != null ) {null ;return newTab;

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 final void treeifyBin (Node<K,V>[] tab, int hash) {int n, index; Node<K,V> e;if (tab == null || (n = tab.length) < MIN_TREEIFY_CAPACITY)else if ((e = tab[index = (n - 1 ) & hash]) != null ) {null , tl = null ;do {null );if (tl == null )else {while ((e = e.next) != null );if ((tab[index] = hd) != null )

扩容流程对比图

几个注意的问题: HashMap在什么情况下灰扩容呢?

当map中包含的Entry的数量大于等于threshold = loadFactor * capacity的时候,且新建的Entry刚好落在一个非空的桶上,此刻触发扩容机制,将其容量扩大为2倍。

最小树形化容量阈值:即 当哈希表中的容量 > 该值时,才允许树形化链表 (即 将链表 转换成红黑树)

LinkedHashMap HashMap 的子类,内部使用链表数据结构来记录插入的顺序,使得输入的记录顺序和输出的记录顺序是相同的。LinkedHashMap与HashMap最大的不同处在于,LinkedHashMap输入的记录和输出的记录顺序是相同的!

LinkedHashMap实现和HashMap最大的区别在于:

1 2 3 4 5 6 static class Entry <K,V> extends HashMap .Node<K,V> {int hash, K key, V value, Node<K,V> next) {super (hash, key, value, next);

LinkedHashMap采用的hash算法和HashMap相同,但是它重新定义了Entry。LinkedHashMap中的Entry增加了两个指针 before 和 after ,它们分别用于维护双向链接列表。特别需要注意的是,next用于维护HashMap各个桶中Entry的连接顺序,before、after用于维护Entry插入的先后顺序的 。

LinkedHashMap的put方法还是使用的HashMap的put方法,并没有进行重写。但是重写了构建新节点的newNode()方法,这个方法会在putVal()方法中被调用。

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 Node<K,V> newNode (int hash, K key, V value, Node<K,V> e) {new LinkedHashMap .Entry<K,V>(hash, key, value, e);return p;private void linkNodeLast (LinkedHashMap.Entry<K,V> p) {if (last == null )else {

LinkedHashMap比较重要的一点就是其重写了三个回调函数:afterNodeRemoval afterNodeInsertion afterNodeAccess 这三个回调函数在特定的操作发生后被调用,通过这三个回调函数维持其有序性。

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 48 49 50 51 52 53 54 void afterNodeRemoval (Node<K,V> e) { null ;if (b == null )else if (a == null )else void afterNodeInsertion (boolean evict) { if (evict && (first = head) != null && removeEldestEntry(first)) {K key = first.key;null , false , true );void afterNodeAccess (Node<K,V> e) { if (accessOrder && (last = tail) != e) {null ;if (b == null )else if (a != null )else if (last == null )else {

因为这三个回调方法中的afterNodeAccess和afterNodeInsertion方法与LRU缓存算法的形成密切相关,就能用作LRU算法,如下,是不是很easy?

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 class LRUCache extends LinkedHashMap <Integer,Integer>{private int size=0 ;public LRUCache (int capacity) {super (capacity,0.75f ,true );this .size=capacity;@Override protected boolean removeEldestEntry (Map.Entry eldest) {return size()>this .size;public int get (int key) {return super .getOrDefault(key,-1 );public void put (int key, int value) {super .put(key,value);

HashTable Hashtable,一个元老级的类,键值不能为空,与HashMap不同的是,方法都加了synchronized同步锁,是线程安全的,但是效率上,没有HashMap快!

同时,HashMap 是 HashTable 的轻量级实现,他们都完成了Map 接口,区别在于 HashMap 允许K和V为空,而HashTable不允许K和V为空,由于非线程安全,效率上可能高于 Hashtable。

如果需要在多线程环境下使用HashMap,可以使用如下的同步器来实现或者使用并发工具包中的ConcurrentHashMap类,但是建议使用ConcurrentHashMap

1 Map<String, Object> map =Collections.synchronizedMap(new HashMap <>());

TreeMap 能够把它保存的记录根据键排序,默认是按键值的升序排序,也可以指定排序的比较器,当用 Iterator 遍历时,得到的记录是排过序的;如需使用排序的映射,建议使用 TreeMap。TreeMap实际使用的比较少!

常用工具类 Collection类

addAll :向指定的集合c中加入特定的一些元素elements

1 public static <T> boolean addAll (Collection<? super T> c, T… elements)

binarySearch:利用二分法在指定的集合中查找元素

1 2 3 4 5 public static <T> int binarySearch (List<? extends Comparable<? super T>> list, T key) public static <T> int binarySearch (List<? extends T> list, T key, Comparator<? super T> c)

1 2 3 4 5 public static <T extends Comparable <? super T>> void sort (List<T> list) public static <T> void sort (List<T> list, Comparator<? super T> c)

1 2 3 4 5 6 7 8 public static void reverse (List<?> list) public static <T> Comparator<T> reverseOrder () public static <T> Comparator<T> reverseOrder (Comparator<T> cmp)

Arrays类

asList:将一个数组转变成一个ArrayList

1 2 3 public static <T> List<T> asList (T... a) {return new ArrayList <>(a);

sort:对数组进行排序,适合byte,char,double,float,int,long,short等基本类型,还有Object类型

1 2 3 4 5 6 7 8 public static void sort (int [] a) public static <T> void sort (T[] a, Comparator<? super T> c) public static void sort (Object[] a)

copyOf:数组拷贝,底层采用System.arrayCopy(native方法)实现。

1 2 3 4 5 public static int [] copyOf(int [] original, int newLength)public static <T> T[] copyOf(T[] original, int newLength)

copyOfRange:数组拷贝,指定一定的范围,底层采用System.arrayCopy(native方法)实现。

1 2 3 4 5 public static int [] copyOfRange(int [] original, int from, int to)public static <T> T[] copyOfRange(T[] original, int from, int to)

equals和deepEquals:判断两个数组的每一个对应的元素是否相等

1 2 3 4 5 6 7 8 public static boolean equals (int [] a, int [] a2) public static boolean equals (Object[] a, Object[] a2) public static boolean deepEquals (Object[] a1, Object[] a2)

toString和deepToString:将数组转换成字符串,中间用逗号隔开

1 2 3 4 5 public static String toString (int [] a) public static String toString (Object[] a)

国庆和中秋终于在2020碰到一起了,国庆快乐!中秋快乐!努力吧少年!